A Linha que Separa Salvar Vidas de Tirar Vidas

Em um mesmo dia, em março de 2026, dois eventos protagonizados pela inteligência artificial ocuparam os noticiários globais e, juntos, formularam com precisão cirúrgica a grande questão moral do nosso tempo: para que, afinal, queremos usar a tecnologia mais poderosa já desenvolvida pela humanidade?

O primeiro evento: o Google anunciou uma solução de IA capaz de prever enchentes repentinas com até 24 horas de antecedência, potencialmente salvando milhares de vidas em regiões urbanas vulneráveis ao redor do mundo. O segundo evento: a Anthropic — criadora do modelo de linguagem Claude — manteve sua recusa pública em fornecer sua tecnologia para sistemas de armamentos autônomos ao Departamento de Guerra dos Estados Unidos, sofrendo retaliações diretas do governo federal americano.

Dois caminhos. Uma mesma tecnologia de base. E uma pergunta que não admite resposta neutra: onde estão os limites éticos e morais do uso da inteligência artificial?

A IA que Salva: o Caso das Enchentes

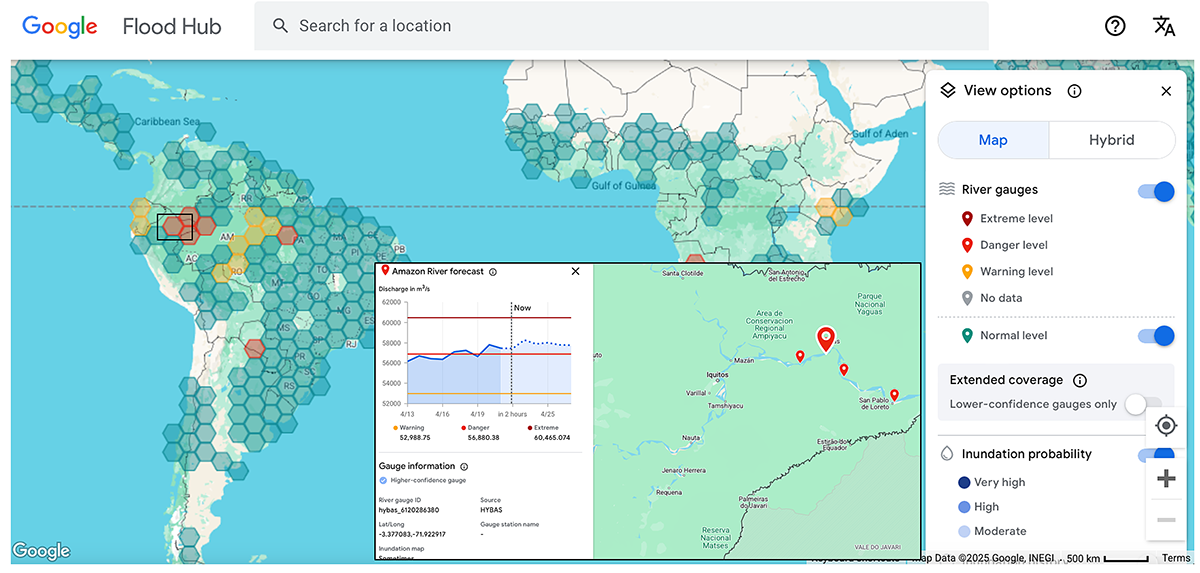

No dia 12 de março de 2026, o Google apresentou ao mundo uma ferramenta construída sobre sua plataforma Gemini e integrada ao Flood Hub — um mapa interativo de previsão de inundações. A novidade não é incremental: representa um salto qualitativo na capacidade da tecnologia de antecipar desastres naturais antes que eles aconteçam.

A solução foi desenvolvida com base em uma metodologia chamada Groundsource, que utilizou décadas de relatórios históricos públicos para identificar mais de 2,6 milhões de eventos relacionados a enchentes em mais de 150 países. Sobre essa base de dados, a IA foi treinada para processar sequências de informações meteorológicas e geofísicas dos últimos sete dias e emitir alertas para as 24 horas seguintes, com resolução espacial de 20 km por 20 km.

O que isso significa na prática?

Significa que uma comunidade ribeirinha no interior do Brasil, uma favela às margens de um rio em Bangladesh, ou um bairro costeiro no sul da Europa podem receber, com um dia de antecedência, um aviso que antes simplesmente não existia. Tempo suficiente para evacuar. Para buscar abrigo. Para salvar uma vida.

“É importante ressaltar que a mesma abordagem baseada em IA do Groundsource tem o potencial de ser aplicada a outros desastres naturais, como deslizamentos de terra ou ondas de calor, transformando relatos verificados de todo o mundo em conjuntos de dados que possibilitam maior resiliência global.”

— Yossi Matias, chefe de pesquisa do Google

Este é o rosto mais luminoso da inteligência artificial: uma ferramenta que amplia a capacidade humana de proteger o que há de mais fundamental — a vida. A tecnologia, aqui, age como extensão da solidariedade. Processa o que nenhum ser humano processaria rápido o suficiente e entrega, no final, uma informação que pode fazer a diferença entre um sobrevivente e uma vítima.

A IA que Recusa: o Caso da Anthropic

Fundada em 2021 por Dario e Daniela Amodei — dissidentes do alto escalão da OpenAI — a Anthropic nasceu de uma insatisfação profunda com o ritmo acelerado e descuidado com que parte da indústria vinha desenvolvendo e lançando sistemas de inteligência artificial. Sua tese fundante é clara: a tecnologia deve ser, antes de tudo, segura e alinhada aos valores humanos.

O principal produto da empresa, o modelo Claude, foi construído sobre o conceito de ‘IA Constitucional’ — uma arquitetura em que o próprio algoritmo é treinado a partir de um conjunto de princípios éticos que funciona como uma constituição digital. O sistema aprende não apenas a executar tarefas, mas a julgar suas próprias respostas com base em valores pré-definidos, evitando ativamente gerar conteúdos danosos.

O confronto com o Pentágono

Diante do cenário de escalada bélica no Oriente Médio e do uso crescente de drones guiados por processamento de dados em tempo real, o Departamento de Guerra norte-americano passou a exigir das grandes desenvolvedoras de IA acesso irrestrito a seus modelos para o aprimoramento de armamentos autônomos — sistemas capazes de identificar alvos e tomar decisões letais com mínima ou nenhuma supervisão humana.

A Anthropic disse não. E manteve o não mesmo diante das consequências. A justificativa da empresa é técnica antes de ser moral: os modelos de linguagem de fronteira ainda sofrem com falhas estruturais de precisão, vieses algorítmicos e o fenômeno das ‘alucinações’ — respostas geradas com aparente confiança, mas factualmente incorretas. Delegar a esses sistemas decisões sobre vida e morte, argumenta a empresa, seria uma irresponsabilidade técnica com potencial de gerar crimes de guerra em escala industrial.

A resposta do governo americano foi proporcional à ousadia da recusa. A administração federal instruiu suas agências a eliminarem gradualmente o uso dos sistemas da Anthropic e chegou a rotular a empresa publicamente como um ‘risco à cadeia de suprimentos’ — classificação historicamente reservada a corporações estrangeiras suspeitas de espionagem.

“Quando uma empresa impõe barreiras éticas voluntárias, ela perde competitividade imediata frente a concorrentes que estão dispostas a ignorar esses mesmos limites em troca de contratos trilionários do orçamento de guerra.”

— CNN Brasil, março de 2026

No vácuo deixado pela Anthropic, a OpenAI avançou. Flexibilizou suas próprias políticas internas e estreitou parcerias com agências de inteligência americanas. A cisão ideológica entre as duas companhias tornou-se tão aguda que seus CEOs recusaram publicamente um cumprimento de mãos em um evento global do setor — um gesto que transcendeu o drama corporativo e ilustrou, em sua dimensão mais humana, o abismo entre duas visões de futuro.

O Espelho Partido: Uma Tecnologia, Dois Destinos

Colocados lado a lado, os dois casos formam um espelho partido — dois fragmentos da mesma realidade tecnológica refletindo mundos moralmente opostos. O Google usando IA para antecipar a morte pela natureza e salvar vidas. A pressão para que outras empresas usem IA para antecipar a morte pelo ser humano e tirar vidas.

Essa dualidade não é nova na história da tecnologia. A fissão nuclear que alimenta usinas de energia é a mesma que destruiu Hiroshima. A criptografia que protege dados bancários é a mesma que esconde comunicações criminosas. A diferença, agora, é a escala e a velocidade com que essas bifurcações se apresentam — e o fato de que os agentes que tomam as decisões não são mais apenas governos e estados-nação, mas empresas privadas com produtos de alcance global.

A pergunta que a regulação ainda não respondeu

O embate entre a Anthropic e o governo americano expôs uma lacuna estrutural: na ausência de marcos regulatórios internacionais robustos sobre o uso de IA em contextos militares, a ética passou a ser exercida por empresas — de forma voluntária, não compulsória. As Convenções de Genebra foram concebidas para um mundo em que o campo de batalha era físico e delimitado. Nada nos tratados existentes foi desenhado para responder a uma pergunta como: um algoritmo pode ser responsabilizado por um crime de guerra?

A resposta, por ora, é o silêncio normativo. E nesse silêncio, o poder de dizer ‘sim’ ou ‘não’ ao uso letal da IA migrou para salas de reunião no Vale do Silício.

Ética como Escolha — e como Custo

É tentador tratar a recusa da Anthropic como um gesto heroico e puro. A realidade é mais complexa e merece honestidade intelectual. A empresa enfrenta agora consequências financeiras diretas, perda de contratos governamentais e uma campanha de retaliação institucional. Sua postura ética tem um preço real, mensurável, que afeta funcionários, investidores e a própria capacidade da empresa de continuar desenvolvendo tecnologia segura.

Isso levanta uma questão incômoda: em um mercado onde a ética tem custo e a ausência de ética tem recompensa, qual é o incentivo estrutural para que outras empresas sigam o mesmo caminho? A resposta honesta é: nenhum — a menos que regulação, opinião pública ou pressão de investidores criem essa demanda de forma sistemática.

Por outro lado, o caso Google ilumina a face mais esperançosa desse debate. Aqui, fazer o bem é também fazer negócio. Previsão de desastres atrai parcerias com governos, agências humanitárias e organismos internacionais. A ética, nesse modelo, alinha-se ao interesse comercial — e isso, paradoxalmente, pode ser mais duradouro do que a ética por convicção pura.

O desafio estrutural do nosso tempo é criar condições para que o modelo Google — onde agir eticamente também é vantajoso — seja a regra, e não a exceção. Enquanto isso não acontece, empresas como a Anthropic sustentam posições éticas à custa de sua própria estabilidade.

Conclusão: O Que Queremos que a IA Seja?

A inteligência artificial não é boa nem má. É, antes de tudo, um espelho — e o que ela reflete depende inteiramente das mãos que a dirigem e dos valores que a orientam. O sistema do Google que prevê enchentes e o modelo que se recusa a guiar armamentos letais partem da mesma física computacional. O que os distingue é o propósito humano inscrito em seu design.

Essa distinção não é técnica. É moral. E as decisões morais mais importantes raramente são tomadas em laboratórios de pesquisa ou audiências parlamentares. Elas são tomadas em momentos de pressão — quando um governo ameaça, quando um contrato bilionário está sobre a mesa, quando a conveniência aponta em uma direção e a consciência aponta em outra.

O que o caso Anthropic nos mostra é que é possível dizer não — e que esse ‘não’ tem um custo. O que o caso Google nos mostra é que a tecnologia, quando orientada para a proteção da vida, pode fazer o que nenhuma outra ferramenta humana ainda foi capaz de fazer: ver o futuro com tempo suficiente para mudá-lo.

A questão que nos resta não é se a IA será usada para fins militares. Ela já é, e cada vez mais o será. A questão verdadeira é se a humanidade terá — na forma de leis, tratados, regulações e, sim, de escolhas corporativas corajosas — mecanismos suficientes para garantir que, no final, prevaleça a IA que salva vidas sobre a que as extingue.

Essa é uma pergunta política, filosófica e civilizacional. E ela está, hoje, sendo respondida — em partes — por empresas privadas. Isso, por si só, deveria nos inquietar profundamente.

Fontes:

CNN Brasil — ‘Anthropic e Guerra no Oriente Médio: entenda atrito da empresa com os EUA’. Publicado em 11/03/2026.

Canaltech — ‘Nova solução de IA do Google prevê enchentes repentinas; entenda como funciona’. Publicado em 12/03/2026.